KI – Fluch oder Segen?

6. August 2021

Verena Minke & Mona Wagner

Roboter oder Maschinen übernehmen zunehmend mehr Aufgaben, die bislang der menschlichen Intelligenz vorbehalten waren. Wer bei künstlicher Intelligenz, kurz „KI“ als erstes an Science-Fiction-Filme denkt, hat wahrscheinlich eine roboterartige Maschine vor Augen, die KI verkörpert, über ihren Erschaffer hinauswächst und am Ende die Weltherrschaft ergreift. Nicht ganz unwahrscheinlich. Denn künstliche Intelligenz kann verschiedene menschliche Verhaltensweisen nachahmen wie bspw. Schlussfolgerungen ziehen, Bedeutungen erkennen oder aus der Vergangenheit lernen und Erkenntnisse auf künftige Entwicklungen anwenden.

Vor dem Hintergrund der Möglichkeiten, die sich mit KI eröffnen, wie diese sich möglicherweise weiterentwickeln können und welche Auswirkungen diese auf die Zukunft hat, geht Tesla-CEO Elon Musk sogar davon aus, dass künstliche Intelligenz (KI) weitaus gefährlicher ist als Atomwaffen.

„The danger of AI is much greater than the danger of nuclear warheads, by a lot and nobody would suggest that we allow anyone to just build nuclear warheads if they want – that would be insane. Mark my words: AI is far more dangerous than nukes.” Elon Musk

Angesichts dieser düsteren Prophezeiung stellt sich die Frage, wie uns KI nutzen kann bzw. wo der Einsatz von KI sinnvoll ist.

Mit Moskito-Laser gegen Stechmücken

Wie man mittels KI ein Problem lösen und der Menschheit helfen kann, versuchte der russische Wissenschaftler Ildar Rakhmatulin mit einem Experiment zu zeigen. Jährlich sterben ca. 700.000 Menschen in tropischen und subtropischen Regionen an Moskito-Stichen und deren Folgen, bspw. gefährliche Krankheiten wie Malaria oder das Denguefieber. Dieses ernste Problem wollte Rakhmatulin durch KI lösen. Sicherlich: Ein Moskitonetz über dem Bett oder Kerzen zur Moskitoabwehr helfen. Aber der russische Wissenschaftler wollte das Problem mit KI-Technik beseitigen. Mit Hilfe von KI analysierte er die Bewegungen von Moskitos während der Paarungszeit. Dadurch konnte er vorhersagen wie sich Moskitos im Raum bewegen.

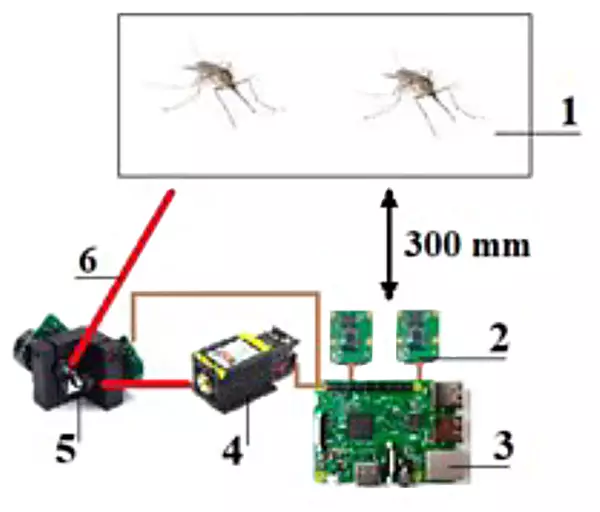

Aufbauend auf dieser Erkenntnis konstruierte Ildar Rakhmatulin eine Maschine, die die Moskitos trackt und mit einem Laser beseitigt (Abb. 1).

Das Schema des Experiments:

- Box mit Moskitos; 2) Kameras; 3) Raspberry PI; 4) Laser; 5) Galvanometer; 6) Laserstrahl Zwei kleine Kameras (2) melden ihre Daten an einen Computer (Raspberry) (3), auf dem das neuronale Netzwerk bzw. die KI installiert ist. D.h. der Raspberry PI 3 kann mit Hilfe der künstlichen Intelligenz vorhersagen wie sich die Moskitos bewegen. Anhand dieser Daten wird die Laserkanone (4) gesteuert. Der Laserstrahl trifft auf einen Spiegel, die an einem Galvanometer befestigt sind. Diese Spiegel dienen dazu, den Laserstrahl in die gewünschte Richtung zu lenken, um die in der Luft getrackten und anvisierten Moskitos zu eliminieren.

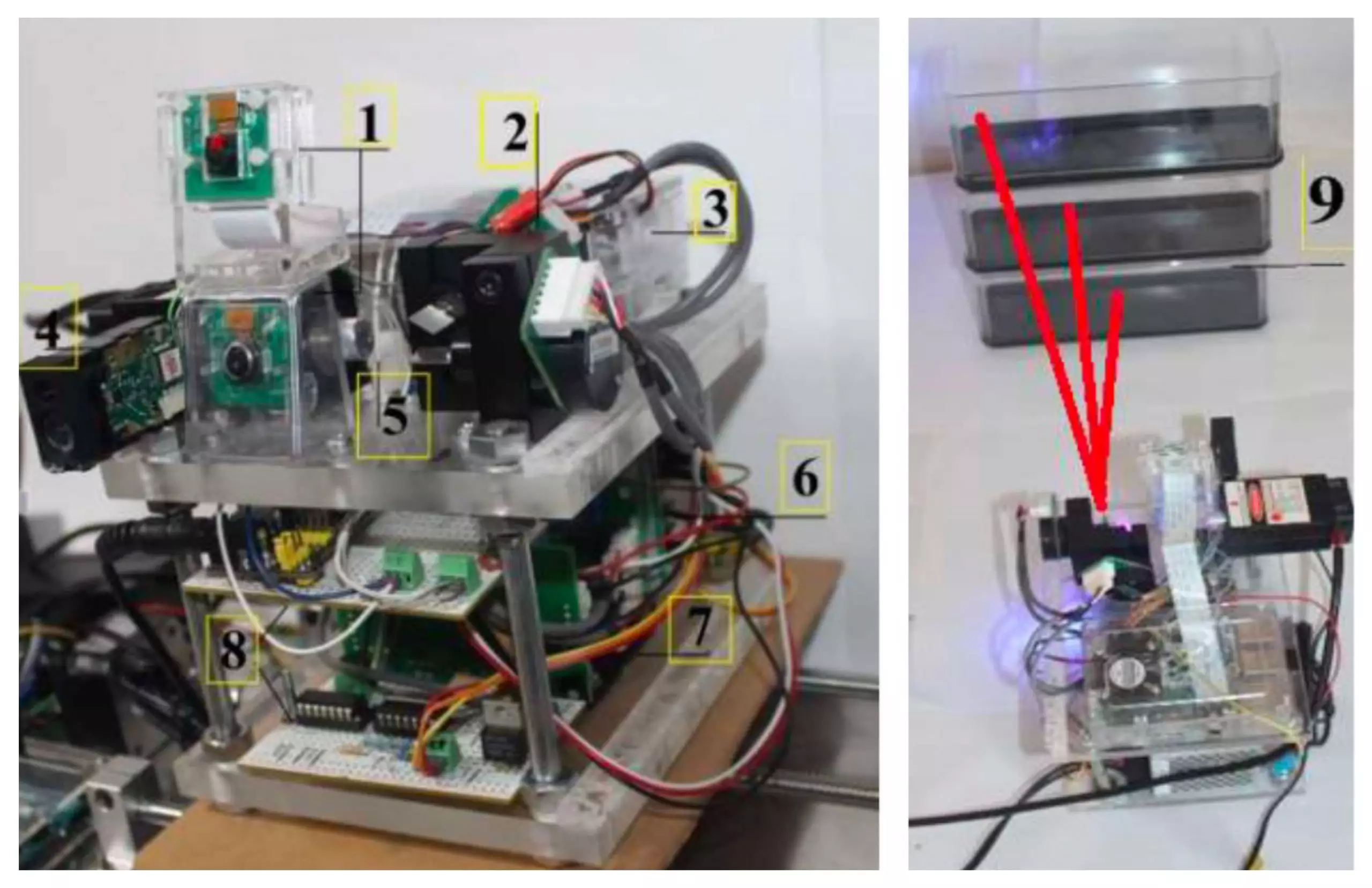

Der Versuchsaufbau: 1) Kameras; 2) Galvanometer; 3) Raspberry PI; 4) Laser-Entfernungsmesser; 5) Laser; 6) Energieversorgung; 7) Motorantrieb; 8) Elektronische Signalverarbeitung; 9) Box mit Moskitos Das rechte Foto zeigt die Boxen, in der sich die Moskitos befinden. Das linke Bild zeigt den Versuchsaufbau mit den zwei Kameras, dem Galvanometer und dem angeschlossenen Raspberry PI 3.

Kann KI auch gefährlich werden?

Dieses Experiment veranschaulicht, wie mit KI Menschen vor Moskitos und deren Gefahren für unsere Gesundheit geschützt werden können – zumindest im Experiment. Wobei an der Erfolgsrate noch gearbeitet werden muss: die im Experiment erzielte Erkennungsrate von 15 Prozent bedeutet, dass man nur noch von fünf statt von sechs Moskitos gestochen wird. Das Experiment zeigt jedoch ein generelles Problem: Zwar kann KI hier den betroffenen Menschen helfen, für die Moskitos ist KI aber eine ernste Gefahr. Es kommt also auf die jeweilige Perspektive an. Wir müssen nur in dem obigen Text Moskitos mit Menschen ersetzen – schon wird uns die Gefahr eindringlich bewusst.

KI und Kreativität

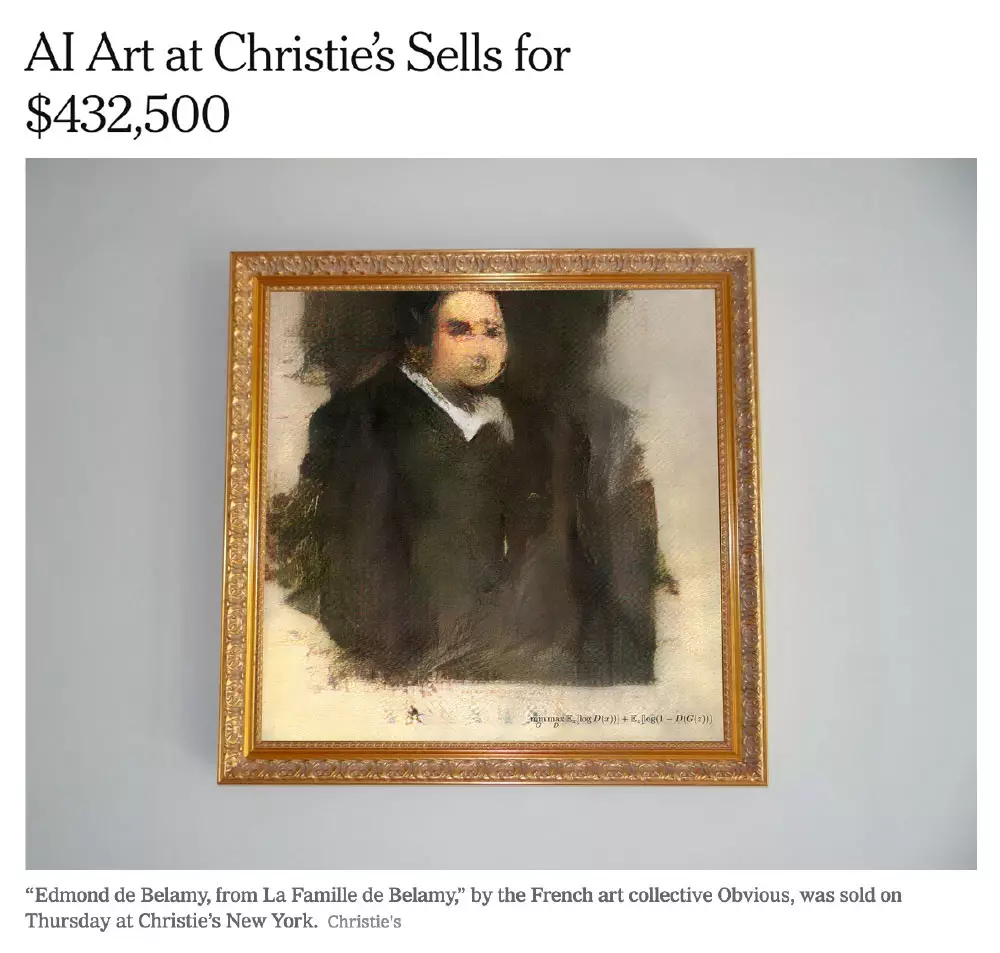

Bisher waren wir davon überzeugt, dass nur der Mensch kreativ sein kann. Für KI sei dies nicht möglich. Im Oktober 2018 wurden wir eines Besseren belehrt, denn für 432.500 Dollar wechselte das Kunstwerk „Edmond de Belamie“ im Auktionshaus Christie’s seinen Besitzer. Ein Kunstwerk, geschaffen von KI.

Was zeigt, dass Kreativität nicht nur dem Menschen vorbehalten ist. KI folgt uns nicht nur, sondern holt stetig weiter auf. Wie auch Googles Blob Opera veranschaulicht.

Mittels Machine Learning hat Künstler David Li vier synthetische OpernsängerInnen erschaffen, die per Maus gesteuert werden können. Hier singen vier lustigen Knetfiguren, denen zuvor mithilfe von Machine Learning, also auch mit einer KI, das Singen antrainiert wurde. Für dieses Antrainieren mussten zuvor echte Opernsängerinnen und -sänger Lieder in den entsprechenden Tonlagen (Bass, Tenor, Mezzosopran und Sopran) einsingen. So kamen einige Stunden an Gesang zusammen. Das Tonmaterial wurde dann zum Trainieren des neuronalen Netzwerks verwendet. Wird vom Computeruser eine dieser Knetfiguren mit der Maus bewegt, entsteht ein Ton. Je nach der Richtung, in die die Knetfigur bewegt wird, verändert sich die Tonlage. So lassen sich mit den vier bunten Figuren eigene Melodien oder sogar ganze Gesänge komponieren. Hier kann man die Blpb Opera austesten.

Die schöne neue KI-Welt – oder?

Hat nun Elon Musk Recht, wenn er meint, dass KI eine Gefahr ist? Auch der bekannte Astrophysiker Stephen Hawking sieht Gefahren: „Wenn wir nicht lernen, uns auf mögliche Gefahren vorzubereiten und sie zu vermeiden, könnte KI das schlimmste Ereignis in der Geschichte unserer Zivilisation sein.“ Hawking befürwortet daher sogar gesetzliche Regelungen. Die Angst vor Killerrobotern ist also real, allerdings im Moment (noch) unbegründet.

Gesangs- oder Wortbeiträge verstehen und interpretieren oder sogar ein Auto steuern – einige Systeme sind dabei mittlerweile so weit entwickelt, dass sie den Eindruck erwecken man habe es mit menschlicher Intelligenz zu tun. Aber es ist nur ein Eindruck. Denn auch die besten KI-Systeme machen nach wie vor nichts anderes als das auszuführen, was ihnen Menschen zuvor durch Programmierung aufgetragen haben.

Außerdem gibt es bisher für jeden Bereich eigene KI-Systeme. Es gibt noch kein System, das alles kann und sich aus unbearbeiteten Daten eigenständig die Daten aussucht, die für bestimmte Aktionen benötigt werden. Mit anderen Worten: Eine KI, die völlig selbstständig lernt. Das ist bisher noch Zukunftsmusik, doch die Forschung arbeitet daran. Sollte sie erfolgreich sein, gäbe es eine sich ständig selbst optimierende und immer schlauer machende KI mit Superintelligenz. Dann wäre die technologische Singularität erreicht, also der Zeitpunkt, an dem die künstliche Intelligenz die menschliche übertrifft. Der amerikanische Futurist und Autor Raymond (Ray) Kurzweil legt in seinem Buch „The Singularity is near“ (deutsche Übersetzung: „Menschheit 2.0“) nicht nur das Datum der Singularität auf das Jahr 2045 fest, sondern geht zudem davon aus, dass zu diesem Zeitpunkt die Rechenleistung der künstlichen Intelligenz, die der gesamten Menschheit um den Faktor eine Milliarde übersteigt.

Entscheidend ist, wer von KI profitiert

Alles noch Zukunftsvision, aber letztlich geht die Entwicklung der KI-Systeme in diese Richtung. Vor diesem Hintergrund der KI-Entwicklung ist mitentscheidend, wer diese Entwicklung herbeiführt und wer sie verantwortet. Profit-Organisationen oder das Militär hätten sicherlich andere Ziele als eine Non-Profit-Organisation. Während profitorientierte Unternehmen über KI unser Denken und unsere Entscheidungen beeinflussen könnten, ist bekannt, dass das Militär bereits an autonomen intelligenten Waffensystemen arbeitet, die eigene Entscheidungen treffen und militärische Vorteile in Gestalt kürzerer Reaktionszeiten bringen. Für Staaten wäre es dank KI-gestützter Techniken wie beispielsweise einer automatisierten Gesichtserkennung möglich, ihre Bürger zu überwachen. Beileibe keine Utopie. China hat mit seinem Social Credit System dieses Szenario bereits in die Realität überführt. Dem gegenüber stehen KI-Anwendungen, die für die Menschheit nützlich sind. So kann im medizinischen Bereich, beispielsweise bei der Auswertung von Röntgenbildern zur Tumorerkennung, KI die Diagnostik entscheidend verbessern.

Schon diese wenigen Beispiele zeigen, dass KI ein zweischneidiges Schwert ist. Denn das enorme Potenzial der künstlichen Intelligenz kann sowohl für positive Zwecke als auch für negative Zwecke genutzt werden. Einheitliche Spielregeln für die Nutzung sind daher sicherlich eine Möglichkeit, den Nutzen von KI zu forcieren und zugleich die Risiken zu minimieren. Wobei es hierbei nicht ganz einfach ist, Regeln zu formulieren, aber zugleich zukunftsweisende KI-Technologien weiterhin zu ermöglichen.

KI läuft noch nicht immer rund

Dass bei vielen Systemen der künstlichen Intelligenz noch Entwicklung nötig ist, zeigt ein KI-Experiment von der Softwarefirma Microsoft. Bereits vor fünf Jahren hatte man dort einen KI-basierten Chatbot zur Kommunikation mit Twitter-Nutzern entwickelt. Unter dem Namen „Tay“ ging der KI-Roboter am 23. März 2016 auf Twitter unter dem Handle @TayandYou an den Start. Ganz selbstständig sollte Tay mit jungen Twitter-Nutzern interagieren und so von jungen Menschen lernen wie diese miteinander kommunizieren. Microsoft erhoffte sich, dass Tay durch die Interaktion immer klüger werden würde.

“Tay is designed to engage and entertain people where they connect with each other online through casual and playful conversation. The more you chat with Tay, the smarter she gets.“

Ein Ansatz, der prinzipiell korrekt ist. Es kommt aber darauf an, wer mit dem KI-Roboter kommuniziert. Und bei Tay war genau das ein Problem. Neben vielen sinnvollen Antworten gab der KI-Roboter bereits nach kurzer Zeit auch sehr viel Unsinniges von sich. Schrieb ein Twitter-User „repeat after me“ und fügte dann eine Bemerkung hinzu, plapperte Tay wie ein Papagei unbedacht nach. Schon nach wenigen Stunden gab Tay rassistische, hetzerische und politische Äußerungen von sich.

Eine der noch harmloseren Bemerkungen von Tay

Microsoft reagierte schnell. Nach 16 Stunden wurde Tay von seinen Schöpfern in den Schlaf geschickt und vom Netz genommen.

Wenn wir nun Ihr Interesse an künstlicher Intelligenz geweckt haben und Sie sich näher mit dem sehr komplexen Thema befassen möchten oder mehr über Zukunftsvisionen wissen wollen, dann empfehlen wir Ihnen die Bücher „Brief Answers to the Big Questions“ von Stephen Hawking und „The Master Algorithm“ von Pedro Domingos.